La course à l’armement entre les superpuissances a toujours été un élément central des relations internationales, façonnant les dynamiques de pouvoir et influençant les stratégies militaires à travers le monde. Dans le contexte actuel, cette compétition prend une nouvelle dimension avec l’émergence de technologies avancées, notamment l’intelligence artificielle (IA). Les États-Unis, la Chine et la Russie, en particulier, investissent massivement dans le développement d’armes autonomes et de systèmes d’IA destinés à renforcer leur capacité militaire.

Cette évolution soulève des questions cruciales sur la sécurité mondiale, les enjeux éthiques et les implications géopolitiques. L’IA, en tant que force motrice derrière cette nouvelle ère de militarisation, offre des possibilités sans précédent pour améliorer l’efficacité des opérations militaires. Des drones autonomes capables de mener des missions de reconnaissance ou d’attaque, aux systèmes de défense sophistiqués qui peuvent anticiper et neutraliser les menaces en temps réel, les applications de l’IA dans le domaine militaire sont vastes.

Cependant, cette avancée technologique s’accompagne de risques considérables, tant sur le plan stratégique que moral. La question se pose alors : jusqu’où les superpuissances iront-elles dans cette quête d’avantage technologique, et quelles en seront les conséquences pour la paix et la sécurité internationales ?

L’impact de la militarisation de l’IA sur la sécurité mondiale

Amélioration de la capacité de réponse

D’une part, elle promet d’améliorer la capacité des nations à répondre rapidement aux menaces émergentes. Par exemple, les systèmes d’IA peuvent analyser d’énormes quantités de données en temps réel, permettant aux forces armées de prendre des décisions éclairées plus rapidement que jamais. Cela pourrait théoriquement réduire le risque d’erreurs humaines dans des situations critiques, où chaque seconde compte. En outre, l’utilisation de drones autonomes pour des missions de reconnaissance ou d’attaque pourrait minimiser les pertes humaines en évitant l’envoi de soldats sur le terrain.

Risques de sécurité

Cependant, cette militarisation pose également des défis majeurs en matière de sécurité. L’un des principaux problèmes réside dans le risque d’escalade involontaire des conflits. Les systèmes d’IA, en raison de leur rapidité d’exécution et de leur capacité à opérer sans intervention humaine directe, pourraient déclencher des hostilités sans que les décideurs aient eu le temps d’évaluer correctement la situation. Par exemple, un drone autonome pourrait interpréter une activité innocente comme une menace et réagir en conséquence, entraînant une réponse militaire disproportionnée.

Prolifération des technologies

De plus, la prolifération de ces technologies pourrait inciter d’autres nations à développer leurs propres systèmes d’IA militaires, augmentant ainsi le risque de conflits armés.

Les enjeux éthiques et moraux liés à la militarisation de l’IA

La militarisation de l’intelligence artificielle soulève des questions éthiques et morales complexes qui méritent une attention particulière. L’un des principaux dilemmes concerne la responsabilité en cas d’erreur ou de catastrophe causée par un système d’ISi un drone autonome commet une erreur fatale, qui est responsable ? Le concepteur du logiciel, le commandant militaire qui a autorisé son utilisation ou l’État lui-même ?

Cette ambiguïté soulève des préoccupations quant à la transparence et à la responsabilité dans les opérations militaires. Un autre enjeu éthique majeur est celui du principe de distinction, qui stipule que les belligérants doivent faire la différence entre les combattants et les civils lors des hostilités. Les systèmes d’IA, bien qu’ils puissent être programmés pour identifier des cibles militaires, peuvent également commettre des erreurs dans l’identification des civils.

Cela soulève des questions sur la légitimité d’utiliser des machines pour prendre des décisions qui peuvent entraîner la perte de vies humaines innocentes. De plus, la possibilité que ces systèmes soient utilisés pour mener des guerres sans intervention humaine directe remet en question notre compréhension même de la guerre et du combat.

La compétition technologique entre les superpuissances

La compétition technologique entre les superpuissances est un facteur déterminant dans la course à l’armement moderne. Les États-Unis et la Chine sont actuellement en tête dans le développement de technologies d’IA militaire, chacun cherchant à surpasser l’autre pour obtenir un avantage stratégique. Les États-Unis ont investi massivement dans des programmes tels que le Project Maven, qui utilise l’IA pour analyser des images aériennes et améliorer les capacités de renseignement.

De leur côté, les chercheurs chinois travaillent sur des systèmes d’armement autonomes qui pourraient transformer le paysage militaire. Cette rivalité technologique ne se limite pas seulement aux capacités militaires directes. Elle s’étend également à la recherche et au développement dans des domaines connexes tels que la cybersécurité et la guerre électronique.

Par exemple, la capacité à mener des cyberattaques précises peut être considérée comme un complément essentiel aux opérations militaires traditionnelles. Les superpuissances cherchent donc non seulement à développer des armes autonomes mais aussi à renforcer leur infrastructure technologique globale pour soutenir leurs ambitions militaires.

Les risques de prolifération et de déséquilibre des forces

La prolifération des technologies d’IA militaire représente un risque majeur pour l’équilibre des forces mondiales. Alors que les superpuissances investissent massivement dans ces technologies avancées, il existe un danger que d’autres nations moins puissantes tentent également de développer leurs propres systèmes d’armement autonomes. Cela pourrait créer un environnement où même des acteurs non étatiques ou des groupes terroristes pourraient accéder à ces technologies, augmentant ainsi le risque d’utilisation abusive.

De plus, cette course à l’armement pourrait exacerber les tensions géopolitiques existantes. Les pays qui se sentent menacés par les avancées technologiques d’une autre nation pourraient être incités à intensifier leurs propres programmes militaires, entraînant une spirale d’escalade qui pourrait déboucher sur des conflits ouverts. Par exemple, si un pays perçoit que son voisin développe une capacité militaire basée sur l’IA qui pourrait lui donner un avantage stratégique, il pourrait être tenté de réagir par une augmentation de ses propres capacités militaires, créant ainsi un cycle dangereux.

Les implications géopolitiques de la course à l’armement des superpuissances

La redéfinition des alliances traditionnelles

La militarisation de l’intelligence artificielle pourrait redéfinir les alliances traditionnelles et modifier les rapports de force sur la scène internationale. Par exemple, les pays qui réussissent à développer des technologies avancées pourraient se retrouver dans une position dominante, influençant non seulement leur propre sécurité nationale mais aussi celle de leurs alliés.

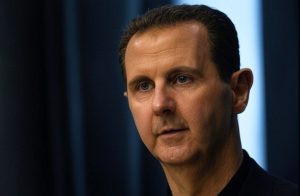

L’exacerbation des rivalités régionales

En outre, cette dynamique pourrait également exacerber les rivalités régionales. Des pays comme l’Inde et le Pakistan, déjà engagés dans une compétition nucléaire intense, pourraient être poussés à développer leurs propres capacités basées sur l’IA pour ne pas être laissés pour compte. Cela pourrait entraîner une instabilité accrue dans des régions déjà sensibles aux conflits armés.

Les implications pour la sécurité internationale

Les implications géopolitiques vont donc bien au-delà du simple développement technologique ; elles touchent aux fondements mêmes de la sécurité internationale.

Les défis de la régulation et du contrôle de l’IA militaire

La régulation et le contrôle de l’intelligence artificielle militaire représentent un défi colossal pour la communauté internationale. Actuellement, il n’existe pas de cadre juridique global qui régisse spécifiquement l’utilisation de l’IA dans le domaine militaire. Les conventions existantes sur le droit international humanitaire ne sont pas nécessairement adaptées aux nouvelles réalités posées par ces technologies avancées.

Cela soulève des questions sur la manière dont les États peuvent être tenus responsables en cas d’abus ou d’erreurs. De plus, la nature même de l’IA rend difficile sa régulation efficace. Les systèmes d’apprentissage automatique évoluent constamment et peuvent être modifiés rapidement par leurs concepteurs ou par ceux qui cherchent à les exploiter à des fins malveillantes.

Cela complique encore davantage la tâche des régulateurs qui doivent anticiper non seulement les développements technologiques actuels mais aussi ceux qui pourraient émerger dans un avenir proche. La coopération internationale sera essentielle pour établir des normes communes et garantir que ces technologies ne soient pas utilisées pour violer les droits humains ou exacerber les conflits.

Les perspectives d’avenir pour la militarisation de l’IA

Les perspectives d’avenir pour la militarisation de l’intelligence artificielle sont marquées par une incertitude croissante. D’un côté, il est probable que les superpuissances continueront à investir massivement dans ces technologies afin de maintenir leur avantage stratégique sur leurs rivaux. Cela pourrait conduire à une course effrénée où chaque nation cherche à développer des systèmes d’armement autonomes toujours plus sophistiqués.

D’un autre côté, il existe également un mouvement croissant en faveur d’une régulation stricte et d’une limitation de l’utilisation militaire de l’IDes organisations non gouvernementales et des chercheurs plaident pour un cadre éthique qui limiterait le développement et l’utilisation d’armes autonomes létales. La question demeure : ces efforts seront-ils suffisants pour contrer la tendance actuelle vers une militarisation accrue ? L’avenir dépendra en grande partie de la volonté politique des nations à collaborer pour établir un équilibre entre innovation technologique et responsabilité éthique dans le domaine militaire.